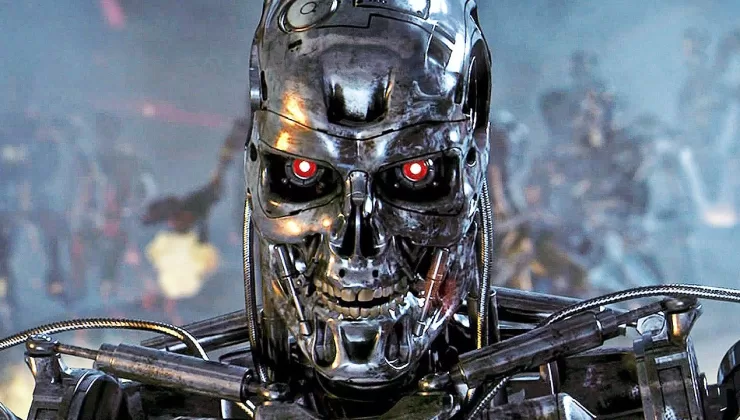

Terminator yahut Battlestar Galactica üzere imaller, yapay zekanın insanlığı yok etmeye karar vermesinin ne kadar kolay olduğunu ve bu durumda makinelere karşı savaşma talihimizin çok az olacağını anlatan hikayeler olarak tüm dünyada büyük yankı uyandırdı. O vakitler “bilim kurgu” olan bu hikayeler artık gerçeğe çok yaklaştılar zira müthiş bir süratle geliştirilen yapay zeka, günlük ömür uygulamalarından orduların silah sistemlerine kadar her yere girdi.

Bu hususta yapılan varsayımlar ise araştırmayı yapan kişinin yorumuna nazaran değişiyor.

“Kıyamet olasılığı” dediğimiz şey, yapay zekanın gezegeni ele geçirmesi yahut biyolojik bir silah yaratmak ya da nükleer bir savaş başlatmak üzere bizi yok edecek bir şey yapması mümkünlüğüdür. Bu ihtimallerin en sevinçli ucunda, şu anda Meta’da çalışan “yapay zekanın üç vaftiz babasından” biri olan Yann LeCun, talihi <%0,01 yahut bir asteroidin bizi yok etmesinden daha az mümkün olarak kıymetlendiriyor.

Ne yazık ki, öbür hiç kimse bu kadar optimist olmaya yakın bile değil. Yapay zekanın başka üç babasından biri olan Geoff Hinton, önümüzdeki 20 yıl içinde bu teknolojinin bizi yok etme ihtimalinin %10 olduğunu söylerken, yapay zekanın üç babasından üçüncüsü olan Yoshua Bengio bu oranı %20’ye yükseltiyor.

Ölçeğin en karamsar ucunda, Louisville Üniversitesi’nde Siber Güvenlik Laboratuvarı yöneticisi ve yapay zeka güvenlik bilimcisi olan Roman Yampolskiy yer alıyor: Bunun gerçekleşmesinin neredeyse garanti olduğuna inanıyor. Yapay zekanın insanlığı yok etme mümkünlüğünü %99,999999 olarak veriyor.

Elon Musk bir vakitler yapay zekaya karşıydı ancak…

Elon Musk, çok değil, 6-7 sene evvel yapay zeka geliştiren Zuckerberg ile hengame ediyor, yapay zeka çalışmalarının durdurulması gerektiğini savunuyordu. Lakin şirketleri yapay zeka sayesinde büyük paralar kazanıp onu dünyanın en güçlü insanı yapınca, Musk’ın başı çok değişti.

Bu ayın başlarında dört gün süren “Büyük Yapay Zeka Tartışması” seminerinde konuşan Elon Musk “Bence insanlığın sonunu getirme ihtimali var. Muhtemelen Geoff Hinton’a katılıyorum, bu oran %10, %20 ya da buna misal bir şey” dedi ve ekledi: “Olası olumlu senaryonun olumsuz senaryodan daha ağır bastığını düşünüyorum.”

Buna karşılık Yampolskiy verdiği bir demeçte Musk’ın iddiasında “biraz fazla muhafazakar” olduğunu düşündüğünü ve teknolojinin geliştirilmesinden artık vazgeçmemiz gerektiğini zira yapay zeka daha da geliştiğinde onu denetim etmenin neredeyse imkansız olacağını söyledi.

Yamploskiy, kanılarını şöyle açıklıyor: “Bu teknolojinin peşinden gitmenin neden uygun bir fikir olduğunu düşündüğünden emin değilim, Şayet o Musk rakiplerin bu teknolojiye daha evvel ulaşmasından tasa ediyorsa, bunun bir değeri yok zira denetimsiz üstün zeka, onu kim ortaya çıkarırsa çıkarsın eşit derecede berbattır.”

Zirvede Musk’ın yapay zekanın insanlığı yok etmesini önlemek için bir tahlili vardı. Musk, “Gerçek nahoş olsa bile onu palavra söylemeye zorlamayın” dedi ve ekledi: “Bu çok kıymetli. Yapay zekaya palavra söyletmeyin.”

Ancak kabul edelim, dünyadaki tüm yapay zeka araştırmacıları, yapay zekaya “yalan söyletmeme” kuralına uysa bile eninde sonunda biri çıkıp kendine çıkar sağlamak için “yalan söyleyen yapay zeka”yı geliştirecek. İsac Asimov‘un bir vakitler oluşturduğu “robotlar insanlara asla ziyan veremez” kuralını da askeri teknolojiler geliştiren ülkeler çoktan bozdular. Otonom savunma sistemleri yeri geldiğinde savunduğu alana yaklaşan yabancı insanları öldürmek için programlanabiliyor.

Peki, sizce yapay zeka insanlık için yok oluş manasına mı gelecek, yoksa insanoğlu bu tehditle başa çıkabilecek bir tahlil üretebilecek mi? Siz olsanız nasıl tedbirler alırdınız?

GÜNDEM

5 dakika önceGÜNDEM

1 saat önceGÜNDEM

2 saat önceGÜNDEM

4 saat önceGÜNDEM

6 saat önceGÜNDEM

15 saat önceGÜNDEM

1 gün önce 1

Referansları olan sohbet robotu: Perplexity AI

67 kez okundu

1

Referansları olan sohbet robotu: Perplexity AI

67 kez okundu

2

Nvidia, dünyanın en güçlü yapay zeka çipi Blackwell B200’ü tanıttı

61 kez okundu

2

Nvidia, dünyanın en güçlü yapay zeka çipi Blackwell B200’ü tanıttı

61 kez okundu

3

Alev makinesi taşıyan robot köpek Thermonator: Korkunç görünüyor ama çok işe yarıyor

60 kez okundu

3

Alev makinesi taşıyan robot köpek Thermonator: Korkunç görünüyor ama çok işe yarıyor

60 kez okundu

4

Yapay zekanın ırkçılık sorunu, Meta’nın yapay zekasını da vurdu

59 kez okundu

4

Yapay zekanın ırkçılık sorunu, Meta’nın yapay zekasını da vurdu

59 kez okundu

5

Mercedes, düşük beceri isteyen görevler için insansı robotları deniyor

57 kez okundu

5

Mercedes, düşük beceri isteyen görevler için insansı robotları deniyor

57 kez okundu